Spatial Memory is an essential part of our everyday life: There is no need for a map to find the way to our best friend’s home, we know where to find milk cartons in our preferred supermarket, and most of the time we remember where we placed the remote control of our TV. In a similar way, spatial memory and technology can be also combined: The desktop of our laptop represents a physical desktop and like in a physical environment, documents and tools can be placed at different positions. Navigating to them is easy when done regularly.

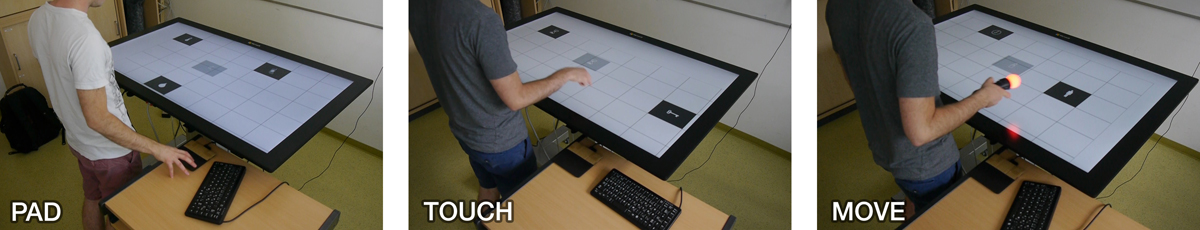

In our paper titled “Memory in Motion: The Influence of Gesture- and Touch-Based Input Modalities on Spatial Memory“, we investigate the influence of three different state-of-the-art input modalities (touchpad, touch, and gesture) and two different off-the-shelf displays (a 10.6 inch tablet and a 55 inch tabletop) on spatial memory performance and object location memory. To do so, we used a well-established task set consisting of (1) a navigation task, where our participants had to navigate to spatially spread symbols and (2) an object location memory task, where participants had to recall positions of the symbols.

Our findings show that participants engage in different interaction strategies when working in different conditions. Depending on the interaction modality and the display size, we identified two trade-offs: The Efficiency vs. Spatial Memory trade-off shows that navigation speed negatively correlates with spatial memory performance, and the User Satisfaction vs. Spatial Memory trade-off shows that a subjective user satisfaction score negatively correlates with the performance of spatial memory, leading to different usage patterns that participants take on to fulfil the task at hand.

We will present that paper at this year’s CHI conference in Denver, Colorado, USA. Feel free to read the paper, watch the video, or use our task for your own experiment.

Reference Paper:

Johannes Zagermann, Ulrike Pfeil, Daniel Fink, Philipp von Bauer, and Harald Reiterer. 2017. Memory in Motion: The Influence of Gesture- and Touch-Based Input Modalities on Spatial Memory. To Appear: In Proceedings of the 2017 CHI Conference on Human Factors in Computing Systems (CHI ’17). ACM, May 2017.